AI Agent (1):从大语言模型应用到智能体

对话能力与行动能力的边界

大语言模型(Large Language Model)之所以会迅速进入公众视野,一个直接原因在于它第一次让“自然语言交互”变得足够流畅。用户不再需要学习复杂的命令格式,只需要像和人交流一样提出问题,就可以得到看起来连贯、完整、甚至颇有条理的回答。这种体验很容易让人形成一种直觉:既然模型已经能够理解问题、组织语言、连续对话,那么它似乎已经具备了“智能体(Agent)”应有的基础能力。

但“会对话”与“能作为智能体完成任务”之间,仍然存在一条明确的边界。对话首先是一种语言生成能力,它解决的是“如何根据输入生成合理的下一段文本”;而智能体面对的问题不是单纯的语言续写,而是在环境中为了某个目标持续做出决策。换句话说,大语言模型擅长回答“应该怎么说”,智能体则必须进一步处理**“接下来应该做什么”**。

这一区别看起来细微,实际上决定了两类系统的能力上限。一个只具备对话能力的系统,通常停留在“单轮或多轮回应”层面:它根据用户当前给出的上下文生成回答,但并不天然拥有稳定的目标表示、显式的任务分解过程,也不一定能够在外部环境中采取行动。它可以解释如何订机票,可以列出制定学习计划的步骤,也可以总结一篇论文的主要内容;但如果要求它真的去比较航班、记录约束、连续修正方案,并在中间步骤受阻时重新规划,它就不再只是一个“回答问题的模型”,而开始接近一个**“围绕目标执行任务的系统”**。

因此,判断一个系统是否可以称为 AI Agent,关键不在于它说得是否像人,而在于它是否具备面向目标的闭环能力。这个闭环至少包含几个要素:接收任务、理解目标、根据环境信息生成行动、观察行动结果、再根据结果调整后续决策。只有当系统能够在这样的循环中持续推进任务,它才不再只是一个语言接口,而开始表现出智能体的基本形态。

从这个角度看,大语言模型更适合作为 AI Agent 的“认知核心”之一,而不是智能体概念本身。它为智能体提供了强大的语言理解与生成能力,使系统能够更自然地读取指令、解释状态、调用知识和组织推理;但目标管理、状态跟踪、工具使用、环境交互与结果反馈,并不会因为模型“能聊天”而自动出现。这些部分恰恰构成了 AI Agent 与一般大语言模型应用之间最重要的差异。

从“回答问题”到“完成任务”

如果说前一节讨论的是边界,那么进一步的问题就是:AI Agent 与大语言模型应用的核心差异,究竟出现在哪里。 一个直接的观察是,很多常见的大语言模型应用本质上仍然是“输入一段文本,输出一段文本”。无论是问答、摘要、改写,还是简单的多轮聊天,系统的主要工作仍然围绕语言本身展开。用户给出需求,模型返回结果,交互往往在回答生成的那一刻就结束了。

但任务型系统并不是这样运作的。现实中的很多问题并不存在“一次回答即完成”的结构。用户提出的目标通常更长,也更复杂,例如查找资料、制定计划、比较方案、分析论文、整理信息,甚至是在中间条件不断变化的情况下逐步逼近结果。在这类场景中,系统需要处理的不只是“当前该说什么”,还包括当前处于任务的哪一步、下一步应该做什么、已有信息是否足够、输出结果是否满足目标。这时,系统面对的对象已经不再只是对话,而是一个持续推进的任务过程。

这也是“应用(Application)”与“智能体(Agent)”开始分化的地方。前者更像是把大语言模型封装成一个能力接口:输入问题,返回答案;输入文本,返回改写结果。它当然可能很有用,但它并不一定关心任务是否真正被完成。后者则更强调目标导向(goal-oriented)。它需要把用户给出的自然语言需求,转化为一个可逐步推进的过程,并在这个过程中维护状态、选择动作、判断结果。

从更抽象的角度看,可以把二者的差异理解为两种不同的问题形式。对于普通的大语言模型应用,问题更接近:

$$ y = f(x) $$这里的 $x$ 是输入文本,$y$ 是模型生成的输出文本。系统的职责主要是完成一次映射。而在 AI Agent 中,问题更接近一个序列决策过程。系统在时刻 $t$ 根据当前状态 $s_t$ 选择动作 $a_t$,环境再反馈新的状态 $s_{t+1}$。这个过程可以写成:

$$ a_t = \pi(s_t), \qquad s_{t+1} = T(s_t, a_t) $$其中,$\pi$ 表示策略(policy),即系统如何根据当前状态选择下一步动作;$T$ 表示环境状态转移。这里最值得注意的是,输出不再只是“答案”,而是“动作”;系统也不再只生成一次结果,而是在“观察—决策—反馈”的循环中持续运行。

这一定义并不意味着 AI Agent 必须像机器人一样拥有物理身体。即使在纯数字环境中,只要系统能够围绕目标执行一系列动作,例如检索信息、调用工具、整理上下文、修正计划、生成中间结果,它就已经表现出智能体的基本特征。相反,一个再流畅、再自然的聊天系统,只要它始终停留在“文本响应”层面,没有进入任务闭环,就仍然更适合被看作大语言模型应用,而不是严格意义上的 AI Agent。

理解这一点之后,后面很多概念会变得更清楚。Agent 的关键不是“更会说”,而是“能够把目标转化为过程,并在过程中持续决策”。 顺着这个思路,下一步就可以更正式地回答:当我们说“智能体”时,通常到底在指什么。

智能体的最小定义

在明确“大语言模型应用”与“AI Agent”之间的差异之后,一个更基础的问题就自然出现了:什么样的系统,才可以被称为智能体。

在人工智能的经典语境中,智能体(Agent)通常指的是这样一类系统:它能够感知环境(environment),根据当前状态做出决策,并通过行动(action)作用于环境,从而推动某个目标的实现。这个定义并不依赖于具体实现方式,也不要求系统一定具有复杂的推理能力。它强调的核心只有两点:一是面向目标,二是能够行动。

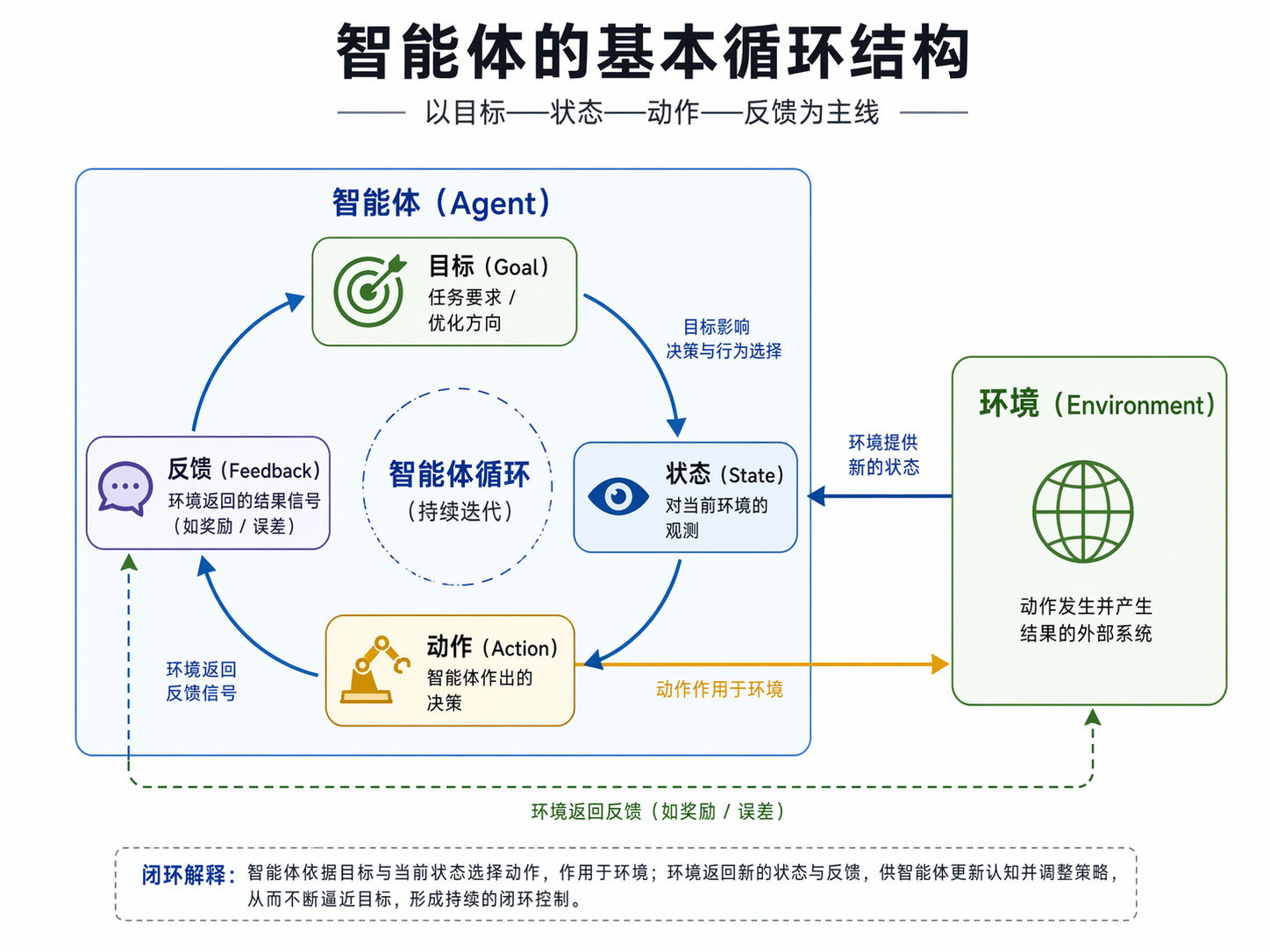

按照这个思路,一个最简化的智能体可以被拆成四个部分。第一部分是目标(goal),也就是系统为什么要运作;第二部分是状态(state),也就是系统当前掌握了什么信息、处于什么位置;第三部分是动作(action),即系统在当前状态下可以采取哪些操作;第四部分是反馈(feedback),也就是动作执行之后,环境返回了什么结果。只要这四个部分形成循环,系统就不再只是被动地产生文本,而是在持续推进任务。

这一过程可以写成一个更完整的闭环:

$$ s_t \rightarrow a_t \rightarrow s_{t+1} \rightarrow a_{t+1} \rightarrow \cdots $$这里的 $s_t$ 表示时刻 $t$ 的状态,$a_t$ 表示该时刻采取的动作。系统的运行不是一次性的输入输出,而是在状态不断变化的过程中连续决策。对于智能体而言,关键问题始终是:在当前状态下,什么动作最有助于实现目标。

这一定义之所以重要,是因为它帮助我们避免把“能力强的模型”与“智能体系统”混为一谈。大语言模型可以承担状态理解、知识调用、语言推理等工作,但它本身未必天然拥有完整的目标管理与行动闭环。只有当模型被放入一个能够维护状态、选择动作、接收反馈的系统结构中时,它才真正参与构成一个 AI Agent。也就是说,智能体不是单一模型的别名,而是一种围绕任务闭环组织起来的系统形态。

从这个角度再看,智能体的“环境”也不必局限于物理世界。在机器人问题中,环境可能是现实空间、传感器输入和执行器反馈;而在基于大语言模型的任务系统中,环境也可以是网页、数据库、文档集合、软件接口,甚至是用户不断补充的上下文。环境的形式可以不同,但逻辑是一致的:系统需要从环境中获取信息,再通过动作改变环境或推进任务。

因此,理解智能体时,最应该抓住的不是它外在的表现形式,而是它内部是否存在一个稳定的任务闭环。只会生成回答的系统,重点在“表达”;能够根据状态持续行动的系统,重点在“决策”。

大语言模型在智能体中的位置

如果智能体并不是新概念,那么这一轮 AI Agent 讨论真正新增的东西,就不在“Agent”这个词本身,而在于大语言模型开始能够承担智能体中的通用决策接口。

传统智能体系统往往依赖人工设计较强的状态表示、动作空间和规则流程。系统能做什么,通常需要在设计阶段被较明确地规定出来。这类方法在封闭环境中有效,但一旦任务描述变得开放、输入形式变得多样,系统就会迅速暴露出脆弱性。原因并不复杂:现实任务往往不是以结构化变量的形式出现,而是以自然语言、文档、网页、对话和模糊约束的形式出现。系统如果不能处理这些信息,就很难真正接近通用任务执行。

大语言模型改变的,正是这一点。它并没有直接等价于智能体,但它提供了一种新的可能:把自然语言转化为统一的任务接口。 用户的目标可以用语言描述,外部信息可以通过文本形式读入,工具的调用说明也可以写成文本,系统的中间推理过程同样可以借助语言组织。于是,原本需要分别建模的很多模块,开始能够在统一的语言空间中衔接起来。

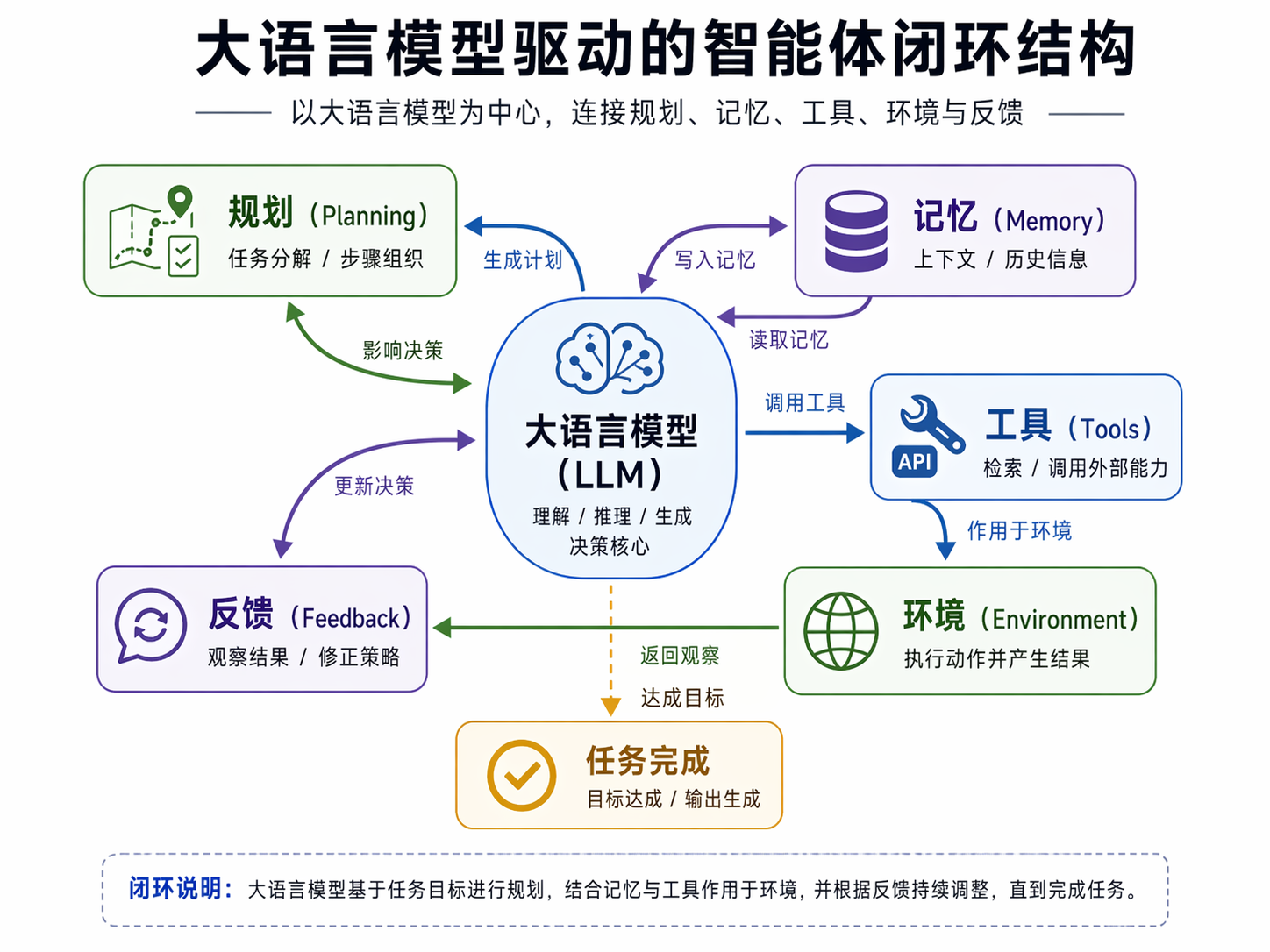

这使得大语言模型在智能体中更像一个“策略核心(policy core)”或者“认知中枢”,负责回答几个关键问题:当前任务是什么,现有信息意味着什么,下一步应该采取什么动作,动作失败后应当如何调整。这里的大语言模型不只是生成自然语言回复,更重要的是承担了任务理解、状态解释与动作选择的功能。也正因为如此,今天讨论 AI Agent 时,很多系统结构都会把大语言模型放在中心位置。

不过,这里仍然需要保持一个清楚的区分:大语言模型负责“决定”,不代表它天然负责“完成”。 决定之后,系统还需要有外部机制去执行动作、记录状态、接收反馈,并把新的结果重新送回模型。换句话说,大语言模型提供的是高层认知能力,但智能体仍然是一个由多个部件共同构成的系统。模型可以判断“应该检索一篇论文”,但真正发起检索的是工具模块;模型可以判断“已有信息不足,需要继续分析”,但真正保存中间结果的是记忆或状态管理模块。

从这个角度看,AI Agent 之所以在大语言模型出现后迅速升温,不是因为我们第一次有了“能说话的模型”,而是因为我们第一次较大规模地拥有了一种可以处理开放任务描述、并能够在多种模块之间充当通用接口的模型。这让智能体不再只适用于高度结构化的小环境,而开始进入更接近真实应用的问题空间。

因此,理解 AI Agent 时,一个很重要的判断是:大语言模型是智能体的重要组成部分,但不是智能体的全部。 只有把模型放进“目标、状态、动作、反馈”的闭环中,再配合记忆、规划与工具机制,系统才会真正从“会理解语言”走向“能围绕目标持续工作”。

规划、记忆与工具为什么会成为 AI Agent 的核心补充

把大语言模型放到智能体的中心位置之后,一个新的问题会立刻出现:如果模型已经能够理解任务、生成推理过程、给出下一步建议,为什么还需要额外引入规划(Planning)、记忆(Memory)和工具使用(Tool Use)这些机制。

原因在于,单次生成能力并不能自动转化为稳定的任务执行能力。大语言模型擅长根据当前上下文生成合理输出,但很多任务并不是“看到问题—立即回答”就能完成的。任务一旦变长,系统就会面临几个非常实际的困难:它需要决定先做什么、后做什么;需要保留此前已经获得的中间信息;还需要在必要时访问外部世界,而不是只依赖参数中已有的知识。规划、记忆与工具,正是为了解决这三类问题而出现的。

先看规划。现实任务通常不是原子的,而是由多个步骤组成的。比如阅读一篇论文并形成结构化总结,往往至少包含识别主题、提取方法、理解实验设计、判断结论边界、最后组织输出等阶段。如果系统没有显式或半显式的规划能力,它就容易停留在“看到请求后立即生成一个看起来合理的回答”这一层,而缺乏对整体任务结构的控制。这样生成出的内容可能流畅,但并不一定完整,更不一定可靠。规划的作用,本质上是把目标转化为过程。

再看记忆。一次任务执行中,系统往往会不断接收新信息,并产生中间结果。没有记忆机制,系统就很难稳定维护“已经知道了什么、还缺什么、哪些约束不能丢”。这不仅影响长任务,也影响多轮交互。用户在前面给出的限制条件、已经确认的结论、尚未解决的分支问题,如果不能被持续保留,系统就会在后续步骤中出现重复、遗漏甚至自相矛盾。这里的记忆并不一定意味着复杂的长期个性化存储,更基本的含义是:系统能够在任务推进过程中维护有效状态。

工具使用则对应另一个更根本的限制:模型本身并不能直接接触外部环境。它可以“知道如何搜索”,但不能仅靠语言生成就真的访问网页;它可以“理解表格分析应该怎么做”,但不能只靠参数完成任意实时数据处理。只要任务需要外部信息、精确计算、数据库查询、文件读取或调用其他软件能力,系统就必须具备工具接口。此时,智能体的动作不再只是输出一段自然语言,还包括发起检索、读取文档、调用程序、写入结果等操作。工具的作用,是把模型内部的判断转化为对外部世界的有效行动。

这三者之间并不是并列堆叠的关系,而是围绕任务闭环形成分工。规划决定任务如何展开,记忆保证任务在展开过程中不丢失状态,工具让任务真正能够作用于外部环境。大语言模型则位于中间,负责理解任务、解释状态、选择动作,并在反馈返回后继续调整。也就是说,今天常见的 AI Agent 并不是“一个更强的模型”,而更接近于这样一种结构:以大语言模型为认知核心,以规划、记忆和工具机制为执行支撑的任务系统。

到这里,AI Agent 的基本轮廓已经开始清晰起来。它之所以不同于普通的大语言模型应用,不是因为多了某种神秘能力,而是因为系统开始具备了把目标持续推进下去的结构条件。

规划为决策建立结构

在 AI Agent 的语境中,规划(Planning)很容易被理解成“先把步骤写出来”。这种理解并不完全错误,但它仍然过于表面。真正重要的不是步骤本身,而是系统是否具备把目标分解为可执行过程、并在过程中持续修正路径的能力。 如果只有一个静态的待办清单,而没有后续的状态判断与调整机制,那么它更像是一份说明书,而不是智能体中的规划能力。

之所以需要规划,是因为很多任务都带有明显的**延迟反馈(delayed feedback)**特征。系统当前采取的动作,未必会立刻显现出最终价值。举例来说,当用户要求系统完成一份论文综述时,“先读哪些材料、如何组织比较维度、何时停止补充资料”这些决策,都会影响最后结果,但每一步本身未必能马上判断对错。没有规划时,系统往往只能依据局部上下文做出短视决策,结果就是内容看似连贯,却缺乏整体结构,或者在局部展开过多,偏离了真正目标。

从形式上看,规划可以理解为:系统不仅要决定当前动作 $a_t$,还要考虑这个动作对未来状态序列的影响。也就是说,它关注的不是单步最优,而是整个过程中的目标推进。若把一段任务执行过程记为状态与动作序列:

$$ s_0, a_0, s_1, a_1, \dots, s_T $$那么规划所关心的,并不是某一个动作单独是否合理,而是这一序列是否能够使系统逐步接近最终目标。换句话说,规划处理的是路径问题,而不是单点问题。

这一区别很关键。大语言模型在没有显式规划支持时,也常常能够生成“看起来像计划”的内容,例如先分析问题,再列出步骤,最后给出结果。但这种计划有时只是语言上的展开顺序,并不一定真正参与了后续决策。系统可能在写出步骤之后,仍然直接跳到最终回答,中间没有根据步骤逐步执行,也没有根据执行结果修正原计划。此时的“规划”只是输出风格的一部分,而不是任务控制机制的一部分。

因此,在 AI Agent 中讨论规划,重点通常落在两个方面。第一,系统能否把一个较模糊的目标转化为若干具有执行意义的子目标(sub-goal);第二,系统能否根据执行反馈对这些子目标重新排序、补充或删除。前者对应任务分解(task decomposition),后者对应动态调整(adaptive revision)。只有这两部分都存在,规划才不只是事前描述,而真正成为任务过程中的控制结构。

这也解释了为什么规划会被视为智能体的重要能力,而不是一个可有可无的附加组件。对于简单问题,直接生成回答可能已经足够;但只要任务开始跨越多个步骤、涉及信息缺失、需要中间判断,系统就必须回答一个更深的问题:为了完成最终目标,现在最值得做的事情是什么。 规划的价值,正是在于为这个问题提供结构化答案。

记忆是任务连续性的条件

一旦把 AI Agent 理解为一个持续推进任务的系统,就可以更直接地理解记忆(Memory)的作用。没有记忆,系统就很难保持任务的连续性;而没有连续性,规划也就很难真正发挥作用。 这一点在短对话中可能不明显,但只要任务跨越多个步骤,问题就会立刻暴露出来。

最常见的情况是,系统在前几步已经获得了一部分信息,也形成了一些中间判断,但在后续处理中却没有把这些内容稳定保留下来。结果就是,它可能重复检索已经看过的资料,忽略用户前面明确给出的约束,或者在新的回答中与先前结论发生冲突。表面上看,这是“上下文记不住”;更本质地说,这是系统没有维护好任务状态(task state)。而记忆的首要作用,正是帮助系统维护这种状态。

从功能上看,记忆至少承担三类信息的保存。第一类是目标相关信息,例如用户真正想完成什么、当前任务的边界在哪里、哪些要求是必须满足的。第二类是过程相关信息,例如已经完成了哪些步骤、已经排除了哪些方案、哪些分支仍然需要继续分析。第三类是结果相关信息,也就是已经获得了哪些中间结论,以及这些结论在后续步骤中应当如何被继续使用。只有当这三类信息能够被持续维护,系统才不至于在任务推进中不断“重新开始”。

这说明,AI Agent 中的记忆并不只是一个“大一点的上下文窗口”。上下文窗口当然重要,它决定了模型一次能看到多少输入;但能看到,不等于能稳定管理。 如果系统只是把大量历史内容机械地拼接到提示中,它仍然可能无法区分哪些信息是关键约束,哪些只是背景材料,哪些已经过期,哪些需要在后续步骤中被优先调用。因此,记忆的问题并不只是“存多少”,还包括“如何组织”和“何时调用”。

在概念上,可以把记忆理解为对状态的显式维护。假设系统在时刻 $t$ 的状态为 $s_t$,在执行动作 $a_t$ 之后获得新的信息 $o_{t+1}$,那么新的任务状态不应只是简单地附加信息,而应当经过更新:

$$ s_{t+1} = U(s_t, a_t, o_{t+1}) $$其中,$U$ 表示状态更新过程。这个式子想表达的核心并不复杂:记忆不是对历史的被动堆积,而是对任务状态的主动更新。 系统需要根据新观察到的结果,重新整理当前“知道什么、缺什么、下一步该做什么”。

这也是为什么在讨论 AI Agent 时,记忆常常会被区分为不同层次。最接近当前任务的是工作记忆(working memory),它负责保存短期执行中必须持续使用的状态;而更长期的用户偏好、历史任务经验、稳定约束等,则更接近长期记忆(long-term memory)的范畴。对于入门阶段,更重要的是先抓住前者:只要任务需要跨步骤推进,就一定需要某种形式的工作记忆。

因此,记忆在 AI Agent 中并不是为了让系统“显得更聪明”,而是为了让系统在任务过程中保持一致性。规划负责决定路径,记忆负责保证路径不会在中途断裂。只有当系统既能分解任务,又能持续维护状态时,“围绕目标持续决策”才不会停留在概念上。

工具使用与外部环境连接

前面讨论规划与记忆时,问题始终停留在系统内部:如何分解任务,如何维护状态,如何让任务连续推进。但一个完整的 AI Agent 还需要处理另一个更现实的问题:系统怎样接触外部世界。 只要任务涉及实时信息、精确计算、文档读取、数据库查询或软件操作,单靠模型参数中已有的知识就不够了。任务能否继续推进,取决于系统是否具备访问外部资源的能力。

这正是工具使用(Tool Use)进入 AI Agent 讨论中心的原因。对大语言模型来说,语言理解和文本生成提供了很强的认知接口,但这类接口主要解决“理解”和“表达”的问题。很多真实任务还要求系统执行更具体的操作,例如搜索网页、读取论文、调用计算器、访问 API(Application Programming Interface)、检索知识库,或者把结果写入某个结构化文件。只有当这些操作能够被纳入任务流程,智能体才具备了对环境施加作用的实际能力。

从智能体视角看,工具的意义在于扩展动作空间(action space)。如果一个系统唯一的动作只是“输出下一段文本”,那么它能做的事情终究有限;而当系统可选动作中加入“检索”“读取”“计算”“调用程序”“写入结果”等类型时,任务执行的范围就会明显扩大。此时,系统在某个状态下做出的决策,已经不再只是决定回复内容,还包括决定应当调用哪一类外部能力。

可以把这个过程抽象地写成两步。系统首先根据当前状态 $s_t$ 选择一个动作 $a_t$:

$$ a_t = \pi(s_t) $$如果这个动作对应某个工具调用,那么工具执行后会返回观察结果 $o_{t+1}$,系统再利用这个结果更新状态:

$$ s_{t+1} = U(s_t, a_t, o_{t+1}) $$这里最重要的变化是,状态更新所依赖的信息不再只来自模型内部生成的文本,还来自外部环境返回的真实结果。这样一来,系统的后续决策就建立在新的环境信息之上,任务闭环也随之真正成立。

这一点直接影响 AI Agent 的可靠性。很多看起来“会回答”的系统,在面对需要外部验证的问题时往往显得脆弱,原因就在于它只能依据已有知识和局部上下文做推断,无法主动获取新信息。工具使用提供了一条更稳妥的路径:当内部信息不足时,系统可以通过动作获取外部证据,再继续推进判断。对于学习型任务、研究型任务和信息整理任务,这一点尤其关键,因为这些场景中的很多结论都依赖具体材料,而不是仅靠语言模型内部记忆就能完成。

工具使用还带来另一个重要变化:任务执行开始具有可分解的中间结果。 例如,系统先检索文献,再读取摘要,再抽取方法,再比较差异。每一步都对应明确的外部操作与返回结果。这样形成的任务链条,比单次生成整段答案更容易分析,也更容易修正。某一步失败时,系统可以定位问题出在哪里,并决定重试、改用其他工具,或调整后续路径。

理解到这里,AI Agent 的基本结构已经大体成形。大语言模型负责解释任务与选择动作,规划负责组织过程,记忆负责维持状态,工具负责把决策连接到外部环境。几个部分共同作用后,系统才开始具备围绕目标持续工作的条件。

AI Agent 作为一种系统范式

经过前面的讨论,可以对 AI Agent 形成一个更稳定的判断:它首先是一种系统范式,而不是某个单独模型的新名称。 这一判断很重要,因为它决定了我们应当如何理解这个领域的真正变化。

如果只从模型能力出发,容易把 AI Agent 理解为“大语言模型能力继续增强后的自然结果”。沿着这条思路,似乎只要模型更强、上下文更长、回答更准确,系统就会自动演化成智能体。但前面已经看到,任务执行涉及的关键问题远不止语言生成,还包括目标表示、状态维护、动作选择、反馈利用以及外部资源接入。它们共同决定系统能否围绕目标持续推进。因此,AI Agent 的核心问题始终是系统如何组织起来,而不只是模型本身有多强。

从系统视角看,AI Agent 可以被理解为一种围绕任务闭环构建的结构:用户给出目标,系统维护状态,根据当前状态选择动作,动作作用于环境后再获得反馈,随后进入下一轮决策。大语言模型在其中承担高层认知与语言接口的职责,但系统的稳定性来自整体结构,而不是某个局部模块的单点提升。只要这个结构成立,系统就具备了智能体的基本形式;如果这个结构缺失,即使模型表现得很自然,也仍然更接近“高级对话系统”。

这种系统范式的意义在于,它改变了我们构建 AI 应用的方式。传统的大语言模型应用通常是围绕“生成一次结果”设计的,关注输入提示如何组织、输出文本如何优化。而 AI Agent 更关注“任务如何持续推进”,因此设计重点会转向状态流、决策流和执行流。系统需要知道当前处于哪一步,已有结论是否足够,是否需要调用外部工具,是否应当修改原有计划。问题的中心从文本生成转向了任务控制。

这也是为什么同样使用大语言模型,不同系统之间的能力差异会非常大。有的系统只能完成一次性的问答或改写;有的系统却可以在多轮条件下持续分析资料、组织中间结果并逐步收敛到目标。决定差异的往往不是模型参数本身,而是模型外部是否存在合理的任务结构。对于初学者来说,这一点尤其值得尽早建立,因为后续无论学习单智能体(Single-Agent)、多智能体(Multi-Agent)、工作流(Workflow)还是更复杂的任务执行框架,本质上都离不开这条主线。

小结

“会对话”并不足以定义 AI Agent。大语言模型(Large Language Model)解决的是自然语言理解与生成问题,它能够把输入组织成连贯的输出,但这仍然主要属于语言层面的能力。AI Agent 所面对的问题更进一步,它要求系统围绕一个目标持续决策,在状态变化和环境反馈中不断推进任务。两者的差异,不在于回答是否流畅,而在于系统是否具备完整的任务闭环。

沿着这条线看,AI Agent 更适合被理解为一种目标驱动的系统结构。在这个结构中,大语言模型提供通用的认知与语言接口,规划负责组织任务过程,记忆负责维持任务状态,工具负责把内部决策连接到外部环境。只有这些部分共同作用,系统才从“生成回答”走向“完成任务”。这也是 AI Agent 在当前语境下真正值得讨论的地方。

到这里,入门阶段最基础的概念框架已经建立起来了:大语言模型不是 AI Agent 的同义词,而是构成 AI Agent 的关键部件之一。